IA responsable en entreprise : conformité AI Act, gouvernance des données et bonnes pratiques éthiques

En mars 2024, une banque européenne de taille intermédiaire a dû suspendre son algorithme de scoring crédit après qu’un audit interne a révélé un biais discriminant systématiquement les femmes entrepreneures. Coût de l’incident : 14 mois de développement perdus, une amende réglementaire et une crise réputationnelle qui a fait les gros titres pendant deux semaines. Cette histoire, loin d’être isolée, illustre parfaitement pourquoi l’IA responsable en entreprise n’est plus un luxe philosophique — c’est une nécessité opérationnelle.

Selon le baromètre 2024 de Capgemini Research Institute, 72 % des dirigeants européens considèrent désormais l’éthique de l’IA comme un enjeu stratégique prioritaire, contre seulement 38 % en 2021. La pression monte de tous les côtés : réglementation, clients, collaborateurs, investisseurs. Et avec l’entrée en vigueur progressive de l’AI Act européen, le cadre se durcit concrètement.

Qu’est-ce que l’IA responsable en entreprise, concrètement ?

L’IA responsable désigne un ensemble de principes et de pratiques visant à concevoir, déployer et superviser des systèmes d’intelligence artificielle de manière éthique, transparente et conforme aux droits fondamentaux. En entreprise, cela se traduit par trois piliers : la transparence des algorithmes, l’équité des décisions automatisées et la protection des données personnelles.

Mais soyons honnêtes : entre la définition académique et la réalité du terrain, il y a un gouffre. D’après mon expérience, la plupart des organisations en sont encore au stade des chartes éthiques affichées dans le hall d’entrée, sans réelle traduction opérationnelle. Le vrai défi, c’est de passer de l’intention à l’implémentation — et c’est précisément là que l’AI Act change la donne.

AI Act : ce que la conformité implique vraiment pour votre entreprise

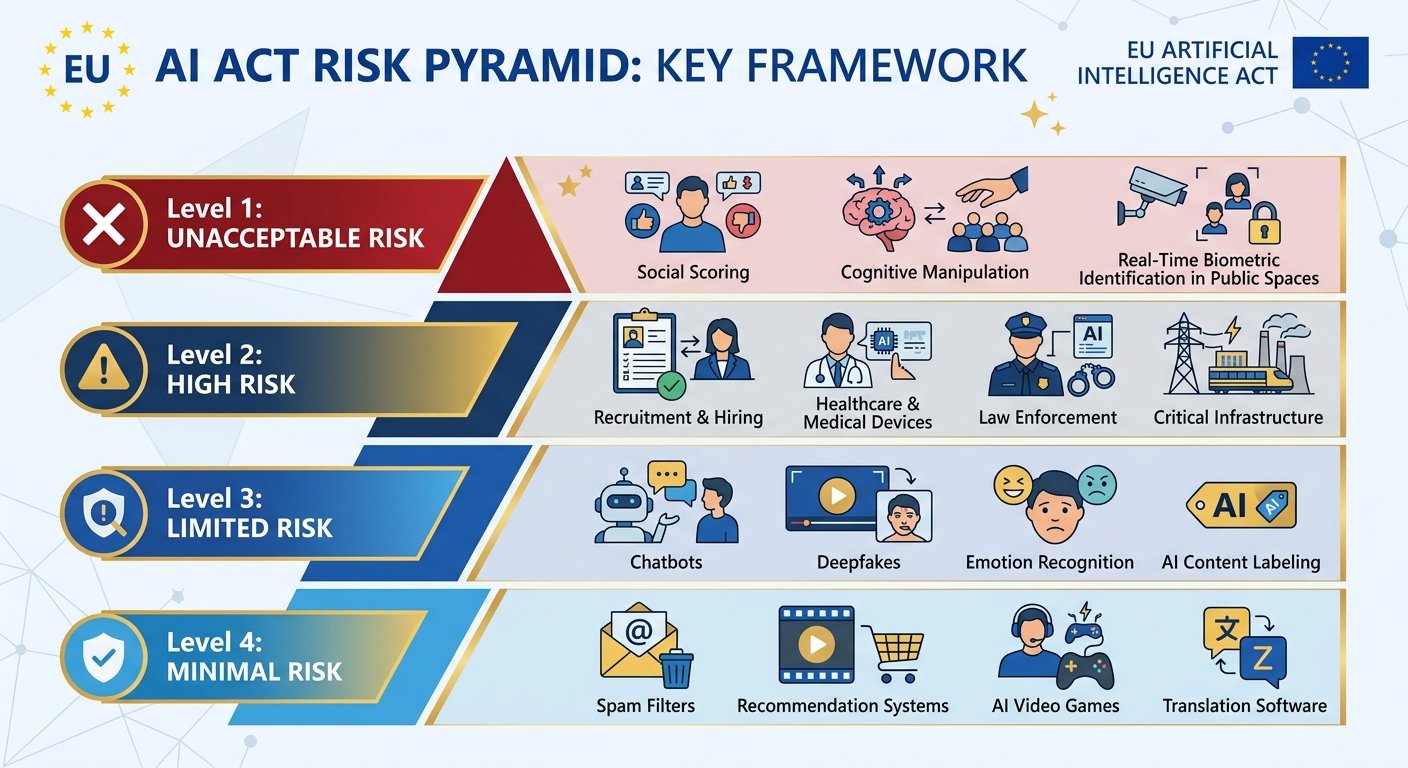

L’AI Act, adopté par le Parlement européen en mars 2024, est le premier cadre réglementaire global sur l’intelligence artificielle au monde. Son architecture repose sur une classification par niveaux de risque : inacceptable, élevé, limité et minimal. Les systèmes à haut risque — recrutement automatisé, scoring financier, diagnostic médical assisté — sont soumis aux obligations les plus strictes.

Concrètement, si votre entreprise déploie un système classé « haut risque », vous devrez garantir une documentation technique exhaustive, réaliser des évaluations d’impact avant mise en production, mettre en place un système de supervision humaine et assurer la traçabilité complète des décisions algorithmiques. Les sanctions prévues vont jusqu’à 35 millions d’euros ou 7 % du chiffre d’affaires mondial. On ne parle plus de recommandations, mais d’obligations légales avec des dents.

À mon sens, l’erreur la plus courante est d’attendre les décrets d’application pour agir. Les entreprises qui anticipent maintenant — en cartographiant leurs usages IA et en classifiant leurs systèmes selon la grille de risques de l’AI Act — prendront un avantage considérable. Celles qui attendent 2026 pour s’y mettre risquent de se retrouver dans la même situation que les retardataires du RGPD en 2018.

Gouvernance des données : le socle invisible de l’IA éthique

Pas d’IA responsable sans gouvernance des données rigoureuse. C’est le socle sur lequel tout repose, et pourtant c’est souvent le parent pauvre des projets IA en entreprise. Un modèle entraîné sur des données biaisées, incomplètes ou mal étiquetées produira inévitablement des résultats problématiques — peu importe la sophistication de l’algorithme.

Les bonnes pratiques commencent par des fondamentaux : documenter la provenance de chaque jeu de données, auditer régulièrement la qualité et la représentativité des corpus d’entraînement, et mettre en place des processus de consentement clairs alignés sur le RGPD. Comme le souligne Cathy O’Neil, mathématicienne et auteure de Weapons of Math Destruction : « Les algorithmes sont des opinions intégrées dans du code. Si les données d’entrée reflètent des préjugés historiques, l’IA les amplifiera. »

D’après mon expérience, les organisations les plus matures sur ce sujet ont nommé un Chief Data Officer avec un mandat éthique explicite, distinct du CTO. Cette séparation des rôles n’est pas un détail organisationnel — elle garantit que quelqu’un dans l’entreprise a pour mission première de challenger la qualité et l’intégrité des données, sans conflit d’intérêt avec les objectifs de performance technique.

Quelles bonnes pratiques adopter dès maintenant ?

Au-delà de la conformité réglementaire, déployer une IA responsable en entreprise repose sur des actions concrètes que toute organisation peut initier sans attendre. Voici les quatre leviers les plus impactants que j’ai vu fonctionner sur le terrain.

- Créer un comité d’éthique IA pluridisciplinaire — pas uniquement composé d’ingénieurs, mais incluant des juristes, des RH, des représentants métiers et idéalement des parties prenantes externes. La diversité de perspectives est le meilleur antidote aux angles morts.

- Systématiser les audits algorithmiques — avant chaque mise en production et à intervalles réguliers ensuite. Des outils comme IBM AI Fairness 360 ou Google What-If Tool permettent de détecter les biais avant qu’ils ne causent des dégâts.

- Former massivement les équipes — pas seulement les data scientists, mais tous les collaborateurs qui interagissent avec des systèmes IA. En 2024, seuls 28 % des employés européens déclarent comprendre comment les décisions algorithmiques qui les concernent sont prises (source : enquête Eurobaromètre).

- Documenter et publier des rapports de transparence — expliquer publiquement quels systèmes IA sont utilisés, à quelles fins, et quels garde-fous sont en place. Cette transparence proactive construit la confiance bien plus efficacement que n’importe quelle campagne de communication.

FAQ sur l’IA responsable en entreprise

L’AI Act s’applique-t-il aux PME ou seulement aux grandes entreprises ?

L’AI Act s’applique à toute organisation qui développe ou déploie des systèmes d’IA dans l’Union européenne, quelle que soit sa taille. Toutefois, des allègements sont prévus pour les PME et startups : accès à des « bacs à sable réglementaires » et obligations de documentation simplifiées pour les systèmes à risque limité. Cela dit, si votre PME utilise un outil de recrutement automatisé, vous êtes pleinement concerné.

Comment savoir si mon système d’IA est classé « haut risque » ?

L’AI Act définit une liste précise de domaines à haut risque dans son Annexe III : identification biométrique, gestion des infrastructures critiques, éducation, emploi, accès au crédit, services publics essentiels et justice. Si votre système IA intervient dans l’un de ces domaines pour prendre ou assister des décisions impactant des personnes, il est probablement classé haut risque.

Quel budget prévoir pour mettre en place une gouvernance IA responsable ?

Les coûts varient considérablement selon la maturité de l’organisation. Pour une ETI, comptez entre 150 000 et 500 000 euros la première année — incluant l’audit initial, la mise en place des processus, les outils de monitoring et la formation. C’est un investissement significatif, mais à comparer avec le coût d’un incident : entre 2 et 15 millions d’euros en moyenne selon une étude McKinsey de 2023.

Peut-on utiliser ChatGPT ou d’autres IA génératives de manière responsable en entreprise ?

Oui, mais avec des garde-fous stricts. Les IA génératives comme ChatGPT, Claude ou Gemini sont classées « risque limité » par l’AI Act, avec une obligation principale de transparence : les utilisateurs doivent savoir qu’ils interagissent avec une IA. En interne, les bonnes pratiques incluent la rédaction d’une charte d’usage, l’interdiction de saisir des données confidentielles et la vérification systématique des contenus générés.

Conclusion : l’IA responsable en entreprise, un avantage compétitif durable

L’IA responsable en entreprise n’est pas un frein à l’innovation — c’est ce qui la rend durable. Entre la conformité AI Act qui impose un cadre légal contraignant, la gouvernance des données qui garantit la fiabilité des systèmes et les bonnes pratiques éthiques qui construisent la confiance, les organisations qui structurent leur approche dès maintenant se positionnent comme les leaders de demain. Le coût de l’inaction est désormais bien plus élevé que celui de l’action. Et ça, les entreprises les plus lucides l’ont déjà compris.